Um diese Frage zu klären, lohnt sich ein genauer Blick darauf, wozu Künstliche Intelligenz tatsächlich in der Lage ist – und wo ihre Grenzen liegen.

KI ist mächtig – aber sie bleibt berechnend. Ein Mensch schreibt, weil ihn etwas bewegt. Weil er eine Stimmung wahrnimmt, gesellschaftliche Entwicklungen beobachtet oder Fragen stellt, die noch keiner gestellt hat. KI schreibt, weil sie dazu beauftragt wurde. Sie erkennt statistische Zusammenhänge, aber keine gesellschaftliche Lage. Sie folgt Algorithmen, nicht einem inneren Antrieb.

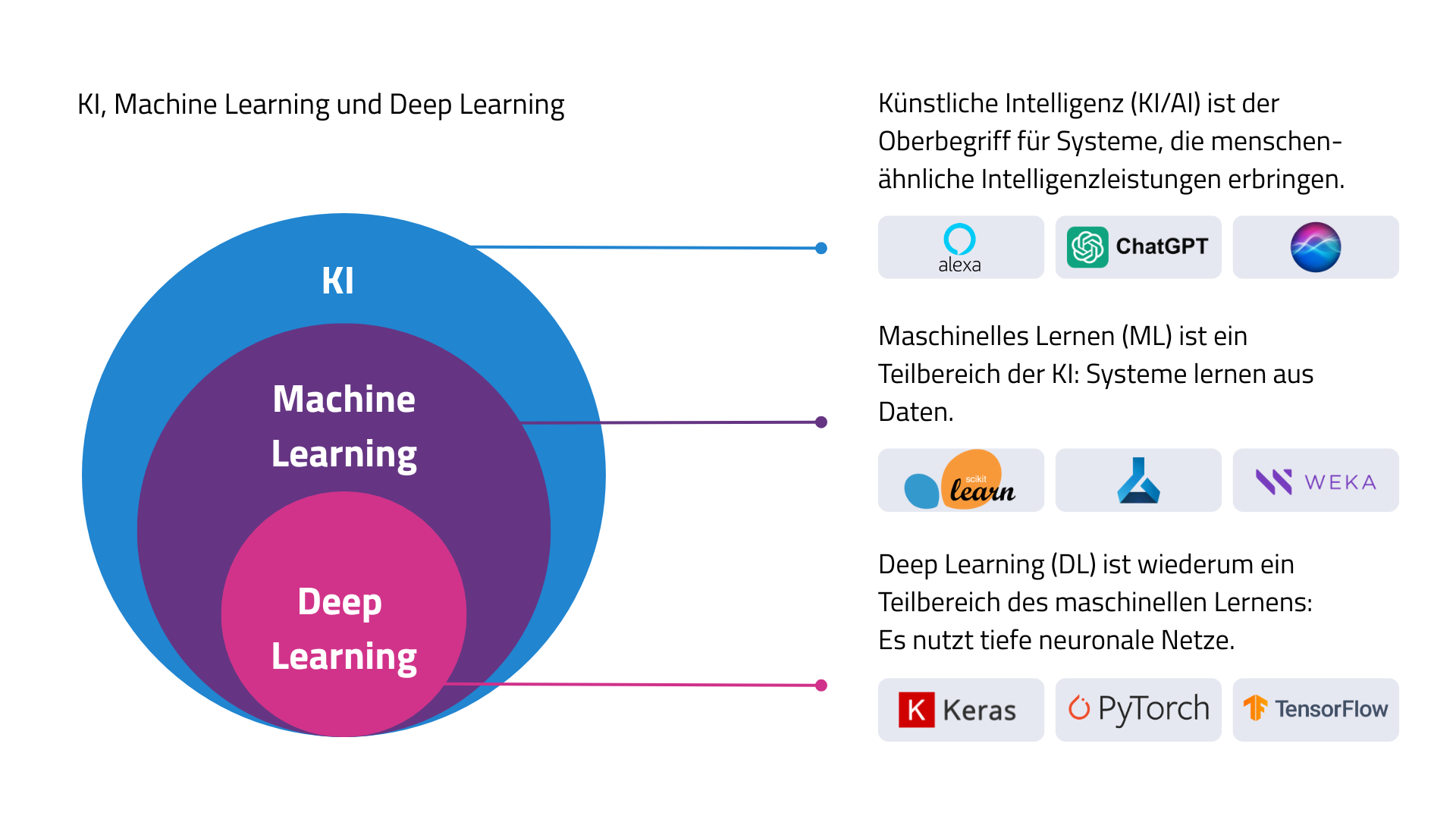

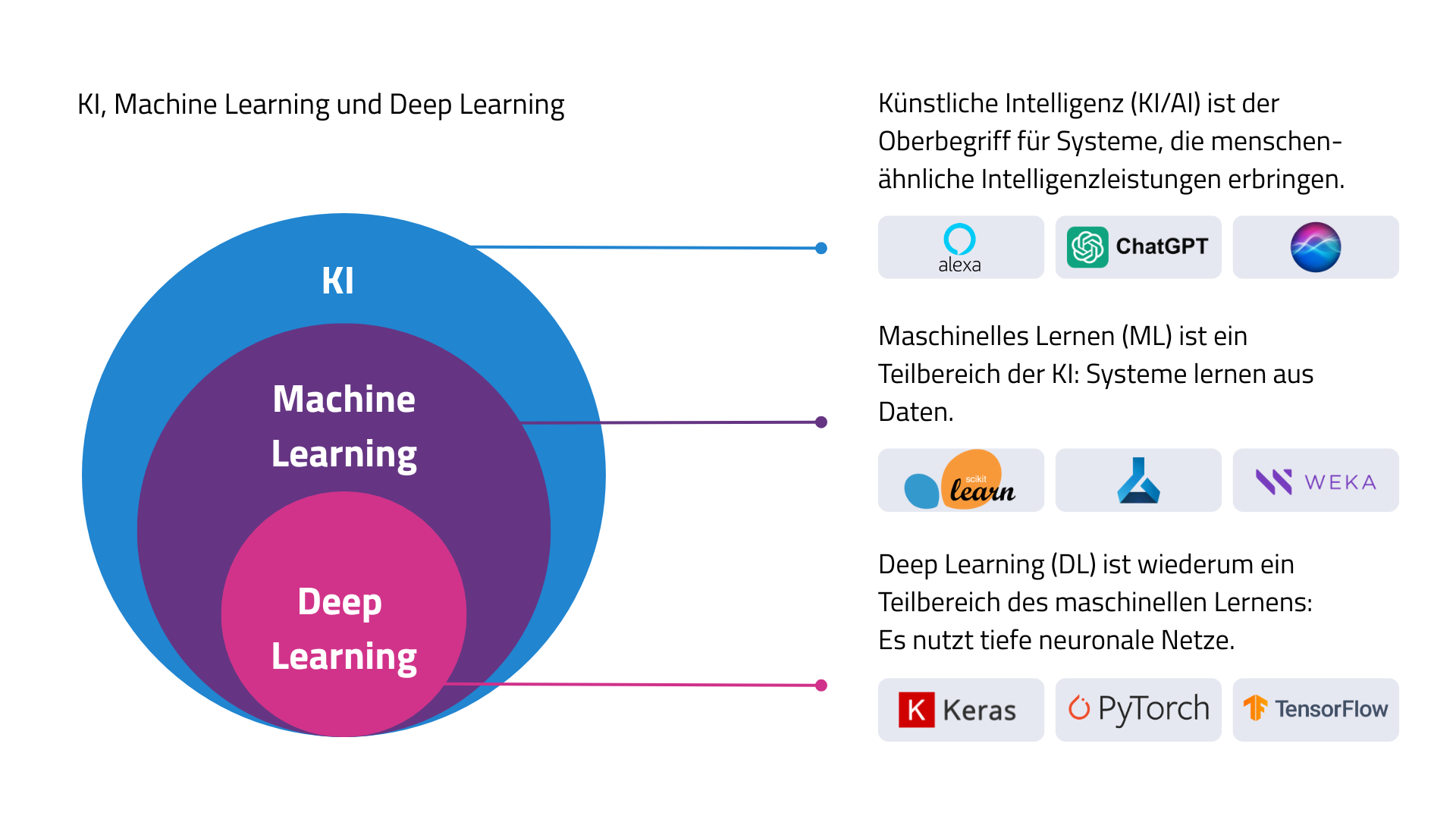

KI ist nicht gleich KI

Die klassische Künstliche Intelligenz basiert auf festen Regeln. Sie folgt einem programmierten Pfad und kann nur das, was ihr vorgegeben wurde.

Machine Learning geht einen Schritt weiter. Hier lernt die KI aus Beispielen. Sie erkennt Muster in historischen Daten und trifft daraus abgeleitete Entscheidungen. Je mehr Daten, desto besser die Prognose.

Noch leistungsfähiger ist Deep Learning. Dabei nutzt die KI künstliche neuronale Netze, die grob dem menschlichen Gehirn nachempfunden sind. Sie können Bilder, Sprache oder komplexe Zusammenhänge analysieren, aber auch hier basiert alles auf Datensätzen.

Was die KI nicht selbst erlebt hat, muss ihr beigebracht werden. Sie hat kein Bewusstsein, keine Intuition und kein echtes Verständnis. Nur Algorithmen, Gewichtungen und Wahrscheinlichkeiten.

Der Mensch lernt durch Emotionen. Durch Erfahrung. Durch Irrtum, Intuition und Interesse. Wir verbinden Informationen mit Gefühlen, Situationen, Zielen. Lernen ist für uns Menschen nicht nur das Speichern von Mustern, es ist ein individueller, persönlicher Prozess.

Deshalb erkennt KI keine Sicherheitslücke, die durch Übermüdung entsteht. Sie spürt nicht, wenn in einem Team die Stimmung kippt oder sich Frust aufbaut. Sie rechnet mit Wahrscheinlichkeiten und kann daher Nachlässigkeit, die aus menschlicher Überforderung entsteht nicht erfassen. Allerdings kann sie die Prozesse imitieren, wenn man sie entsprechend programmiert, füttert, einstellt.

Die Grenzen der KI in Unternehmen

In vielen Anwendungsfeldern ist KI heute ein hilfreiches Werkzeug – etwa bei der Analyse von großen Datenmengen, der Optimierung von Prozessen oder der Unterstützung bei Routineaufgaben.

Doch gerade wenn es um Sicherheit, Unternehmenskultur, Führung oder ethische Entscheidungen geht, stößt sie an ihre Grenzen. Hier braucht es mehr als Mustererkennung – hier braucht es menschliches Urteilsvermögen, Einfühlungsvermögen und Verantwortung.

Was passiert, wenn KI trotzdem Entscheidungen treffen muss – zum Beispiel über Leben und Tod? Und wie stellen wir sicher, dass diese Entscheidungen richtig sind?